見失いそうなので、、、取り急ぎ、hatenaに。Invariant Risk Minimization 解読

https://arxiv.org/pdf/1907.02893.pdf

Arjovsky, M., Bottou, L., Gulrajani, I., & Lopez-Paz, D. (2019). Invariant risk minimization. arXiv preprint arXiv:1907.02893.

Introduction(の導入部)

DeepL翻訳

機械学習には,根本的な問題があります.機械は学習誤差を最小化することで複雑な予測ルールを学習することができますが,データには選択バイアスや交絡因子などの特殊性が含まれていることがあります[49, 48, 23].そのため,機械はこれらのデータバイアスを正当に受け継ぐことになります.この制限は,機械学習が人工知能の約束を果たせない場合に,本質的な役割を果たします.具体的には、学習エラーを最小限に抑えることで、機械は学習データに見られる相関関係をすべて無謀にも吸収してしまうのです。どのパターンが有用であるかを理解することは、データのバイアスに起因するスプリアスな相関は、関心のある因果関係の説明とは無関係であるため、相関対原因のジレンマとして以前から研究されています[31, 27, 35, 52]。これは、機械学習システムがデータの偏りに過度に依存するのを緩和し、新しいテスト分布に一般化できるようにするためです。

Introに対する コメント

いい導入ですね!!!

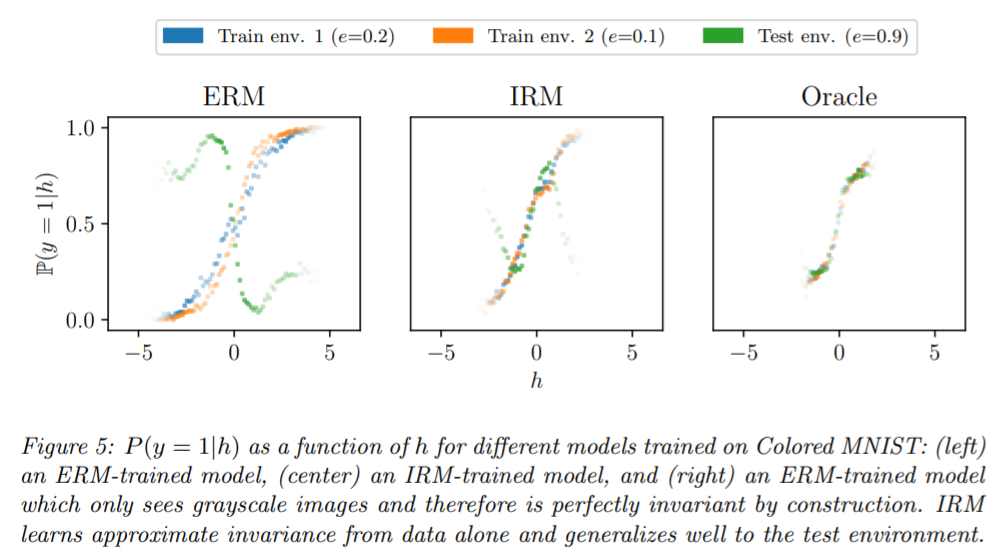

なんか面白そうな図

出典:この論文